文章图片

2.3 端到端机器学习全生命周期

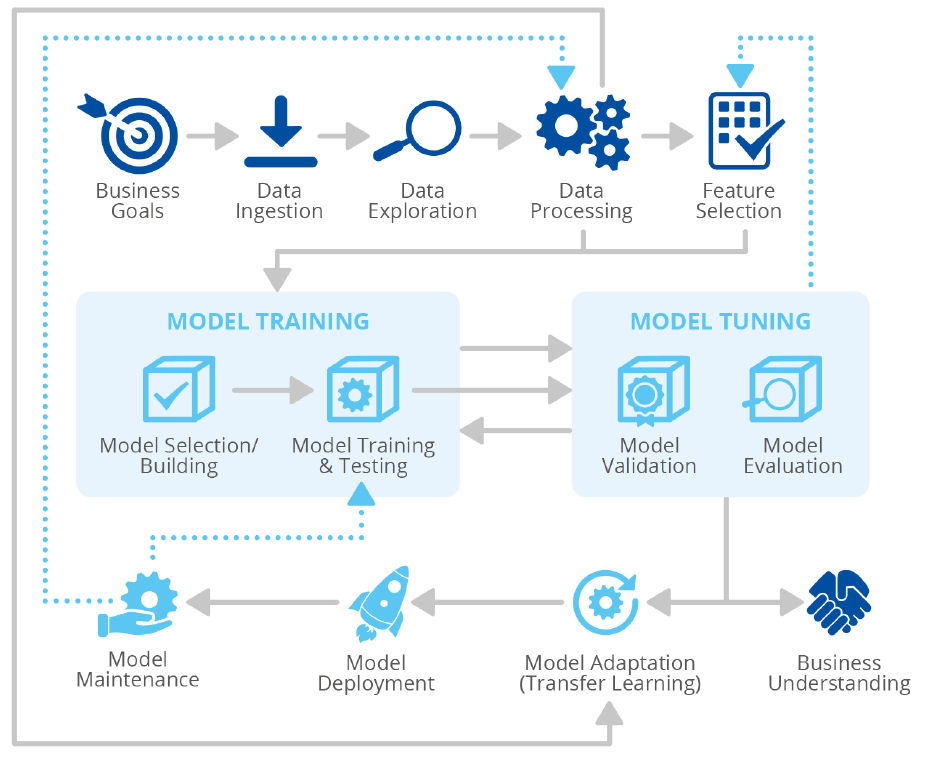

人工智能系统的生命周期包括几个相互依赖的阶段 , 从设计和开发(包括需求分析、数据收集、培训、测试、集成等子阶段)、安装、部署、操作、维护和处置 。

人工智能生命周期通用参考模型 , 如图所示:

文章图片

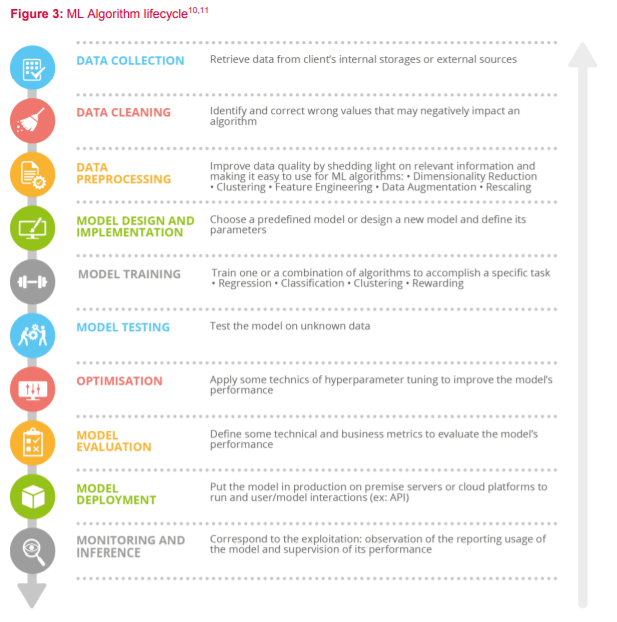

一个典型的机器学习算法全生命周期:

数据收集:从客户端的外部存储或内部存储来提取数据;

数据预处理:提高数据质量 , 具体的方法有降维处理、聚类、特征工程、数据增强等;

模型设计和实现:选择一个预定义的模型或设计新的模型 , 并定义模型参数;

模型训练:训练一个或多个算法来完成特定的行为 , 可以采取的方法有正则化处理、分类、聚类、奖励方法;

模型测试:在未知的数据上对模型进行测试;

优化:使用超参数调整等方式来改善模型性能;

模型评估:定义评估模型性能的技术和商业指标;

模型部署:将模型在生产环境的服务器或云平台上数据 , 并进行用户交互;

监控和推断:对模型的使用和性能进行监控 。

文章图片

3.威胁和漏洞

机器学习算法威胁和漏洞

3.1 机器学习算法威胁

机器学习算法的威胁包括: 绕过、Oracle、投毒、模型或数据泄露、针对机器学习应用组件的攻击、机器学习应用的失效或功能错误 。

- 绕过:攻击者利用机器学习算法的输入的小的抖动来引发输出发生比较大的变化 , 比如决策错误 。 此类修改的输入就是所谓的对抗样本 。

- Oracle:攻击者通过利用精心伪造的输入来观察输出以分析模型 。 这类攻击是绕过或投毒攻击的前一步 。 比如 , 攻击者可以研究输入和输出对的关系 , 并使用这些结果来提取训练数据 。

- 投毒:攻击者可以通过修改的数据或模型来修改机器学习算法的行为 。 此类攻击也叫做因果推断攻击 。

- 模型或数据泄露:此类威胁是指模型的全部或部分信息泄露的可能性 。 可以分为数据泄露和模型泄露两类 。

- 针对机器学习应用组件的攻击:此类威胁是指机器学习应用的组件或开发工具被黑 。 比如 , 机器学习应用开发者使用的开源库被黑 。

- 机器学习应用的失效或功能错误:此类威胁是指机器学习应用失效 , 比如由于恶意输入导致的DoS、处理错误导致的不可用 。 但其中不包括商业用例的失效 。

机器学习算法威胁与漏洞的对应关系如下:

绕过对应的安全漏洞有:

缺乏对异常输入的检测;

模型设计实现过程中对绕过攻击的考虑不足;

缺乏对基于对抗攻击的训练;

使用广泛应用的模型 , 攻击者可以利用模型来研究输入 , 并生成攻击者控制的输入输出对;

Oracle对应的安全漏洞有:

访问权限管理不合理;

模型允许隐私信息被提取;

输出中包含过多的信息;

模型信息暴露过多;

缺乏对可能攻击的考虑;

缺乏维护机器学习应用组件高安全等级的安全过程;

机器学习模型组件的访问保护机制不足 。

投毒对应的安全漏洞有:

模型易被投毒;

缺乏增强对抗投毒鲁棒性的数据;

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。