在外界的印象里 , 个性化推荐就像漏斗一样 , 会将推荐内容与用户相匹配 , 倾向于向用户推荐高度符合其偏好的内容 , 致使推荐的内容越来越窄化 。

但与外界的固有认知相反 , 《报告》认为在行业实践中 , 互联网应用(特别是位于头部的大型平台)有追求算法多样性的内在动力 。

在对行业内代表性应用的数据分析后 , 《报告》表明 , 阅读内容的类型数量是否够多、所阅读内容类型的分散程度是否够高 , 与用户是否能长期留存关联密切 , 呈正相关 。 上述两项指标对用户长期留存的作用 , 可以与信息的展现总量、用户的停留时长、用户阅读量等指标的影响相媲美 。

推荐技术并不是单纯地“投其所好” 。 在一些专家看来 , 在推荐已知的用户感兴趣内容基础上 , 如果能深入激发、满足用户的潜在需求 , 那么算法就能更好地满足人对信息的多维度诉求 。

文章图片

贵州返乡创业青年丁浪用抖音号@黔东农仓 记录腌蒜苔制作过程 。 在推荐系统的帮助下:1)视频能被准确推荐给对乡村美食、农特产品感兴趣的用户;2)用户能顺势在同屏搜索框中搜索、了解蒜苔烹饪相关内容 , 扩展相关知识 。6. 算法如何服务人对安全的诉求?

在人工智能技术快速发展的今天 , 内容安全一直是公众关注的重点 。

《报告》观察发现 , 当前很多内容创作与分发平台 , 从创立之初就将用户和内容安全问题视为最高优先级问题 。

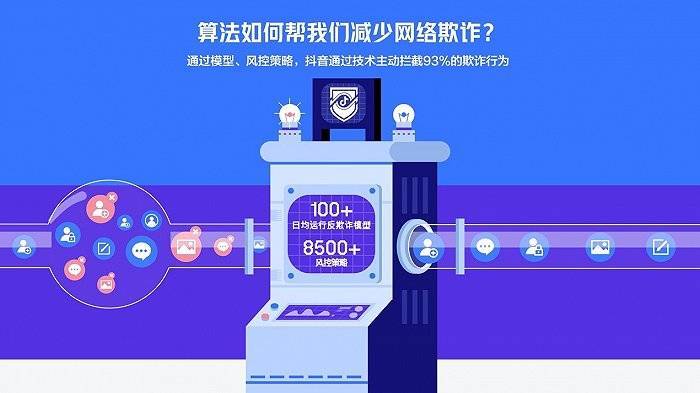

以今日头条为例 , 在内容安全技术方面采用了鉴黄模型、谩骂模型以及低俗模型等内容识别技术 。 抖音安全中心则自主研发反欺诈模型、风控策略 , 结合抖音产品功能、内容属性、用户行为特征 , 对欺诈行为进行主动拦截 。

文章图片

抖音安全中心通过算法技术主动拦截欺诈行为 7. 推荐技术如何服务人对公平的诉求?

《报告》认为 , 推荐系统中的“公平”是站在不同角度定义问题 。

比如在招聘网站上 , 求职者方可能将公平定义为“相同的学历和能力可以被推荐类似的工作 , 而不受国籍、种族和性别等偏见”;对于招聘方 , “公平”可能为“系统可以将他们的招聘信息推给优质的求职者 , 而不会因为公司的背景等因素 , 只将招聘信息推给不太合适的求职者” 。

从关注的角度出发 , 《报告》认为公平性可分为“用户角度”、“物品角度”这两种公平性 。

用户偏好放大是针对用户方(user)的公平性问题 , 体现为用户搜索了一样东西后 , 接下来一段时间的推荐都与该物品相关 。 流行度偏差 , 则通常是针对物品方(items)的公平性问题 , 体现为推荐系统更多推荐较为流行的物品 , 而不流行的物品有较少的机会被推荐或展示 , 造成推荐系统中的“马太效应” 。

当前 , 学界对算法公平性的研究与探讨正不断深入 。

麻省理工学院(MIT)在2021年发布的十大突破技术(10 Breakthrough Technologies)中指出 , TikTok推荐算法能够使普通人发的内容有机会受到名人般的关注并流行起来 , 这是内容公平性的体现;而需求较为小众、细分的用户 , 也能看到符合自己兴趣的内容 , 则是用户角度公平性的体现 。

文章图片

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。