DDC 由两个子模型组成:onset(生成音符的时机)和 sym(决定音符类型 , 如轻按或滑动)

目前正在使用的 AI 模型在所有难度的曲谱上都获得了很好的效果 , 研究人员还展望了该技术扩展到其他领域的可能性 。

文章图片

论文链接:https://arxiv.org/abs/2202.12823

KLab 应用深度生成模型来合成乐谱 , 并改进乐谱的制作流程 , 将业务成本降低了一半 。 该研究阐明了如何通过专门用于节奏动作的多尺度新模型 GenéLive! , 借助节拍等来克服挑战 , 并使用 KLab 的生产数据集和开放数据集进行了评估 。

方法

此前 , KLab 乐谱的生成工作流是在不考虑自动化的情况下形成的 , 几乎没有达成明确的规则或数学优化目标 。 因此 , 该研究选择使用监督机器学习 。 到 2019 年底 , KLab 已经发布了数百首歌曲的音频序列和相应的人工生成乐谱 。

一方面 , 这个项目被要求快速交付并起到协助的作用;另一方面 , 项目的目标具有挑战性 , 旨在改进 SOTA 深度生成模型 。 通常 , 研究新型神经网络架构需要大量的反复试验 , 这个过程需要六个月或更长时间 。

为了解决时间上的问题 , 该研究组织了一个模型开发团队和一个模型服务团队 , 通过与艺术家团队保持联系获得反馈 , 将其反映到模型开发和服务中 , 并在第一时间提供更新的模型 , 从而使他们保持一致 。

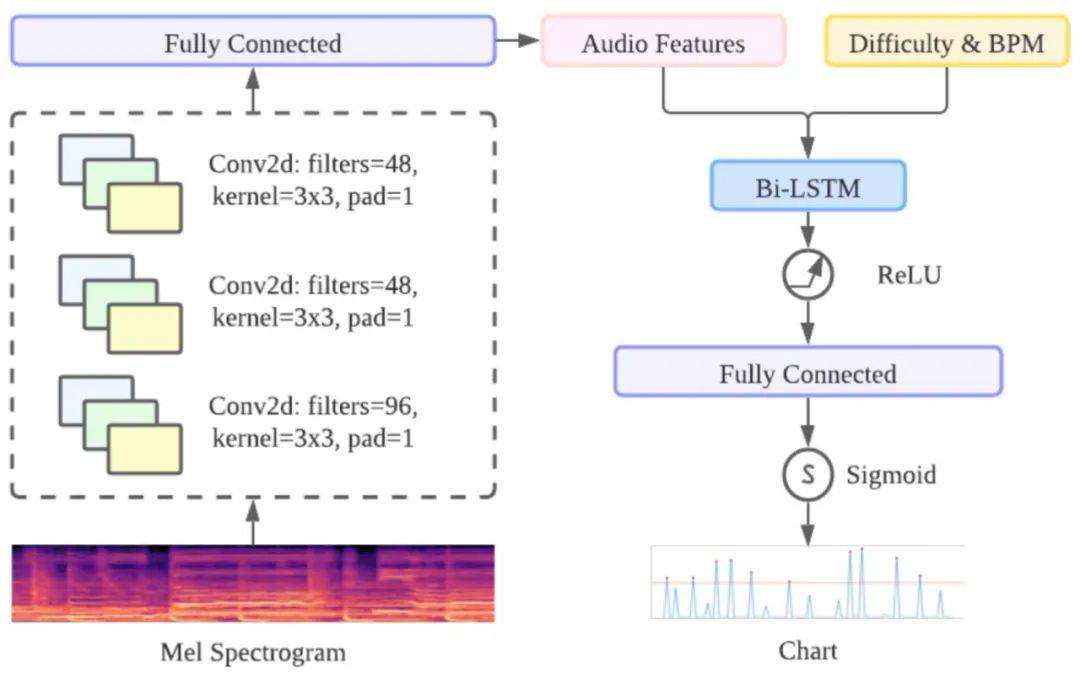

GenéLive! 的基础模型由卷积神经网络 CNN 层和长短期记忆网络 LSTM 层组成 。 对于频域中的信号 , 作者利用 CNN 层来捕获频率特征 , 对于时域利用 LSTM 层来完成任务 。

文章图片

GenéLive! 的模型架构 。

在这里 , 卷积堆栈(conv-stack)的主要任务是使用 CNN 层从 mel 频谱图中提取特征 。 conv-stack 包括一个具有批量标准化的标准 CNN 层、一个最大池化层和一个 dropout 层 , 激活函数是 ReLU 。 最后为了规范输出 , 这里使用了全连接层 。

时域方面采用了 BiLSTM , 提供前一个 conv-stack 的输出作为输入 。 为了实现不同的难度模式 , 作者将难度编码为一个标量(初级是 10 , 中级是 20 , 以此类推)并将这个值作为新特征附加到 convstack 的输出中 。

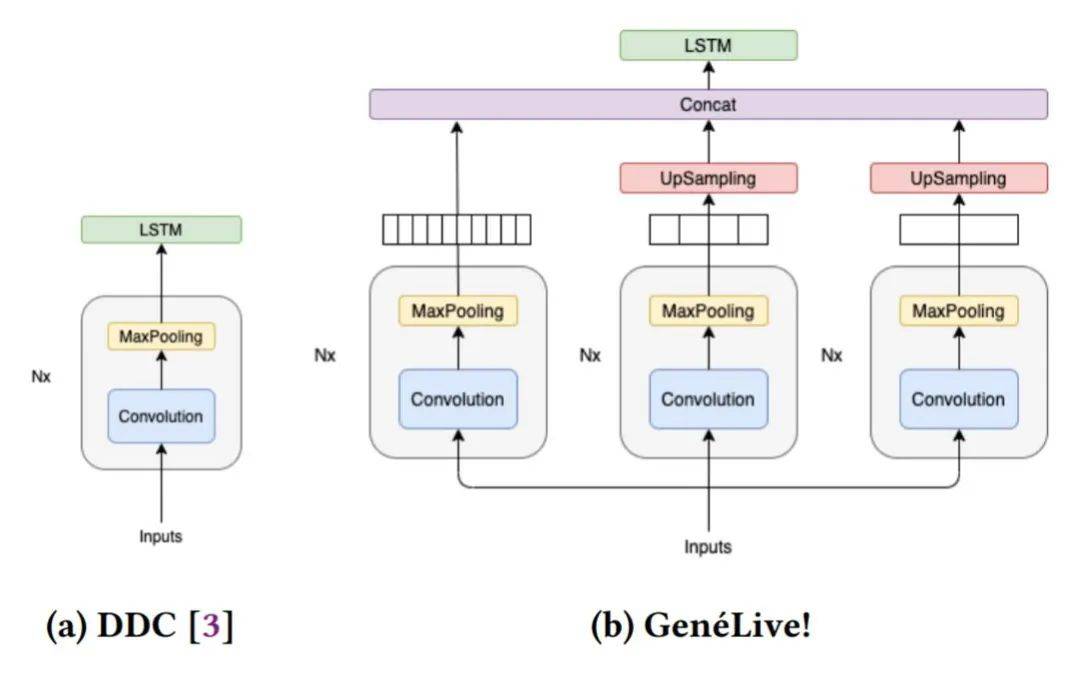

文章图片

Conv-stack 架构 。

在训练数据方面 , GenéLive! 使用了几百首早期的 LLAS 歌曲 , 《歌之王子殿下》的歌曲 , 以及音乐游戏引擎「Stepmania」中可公开访问的音乐和乐谱 。

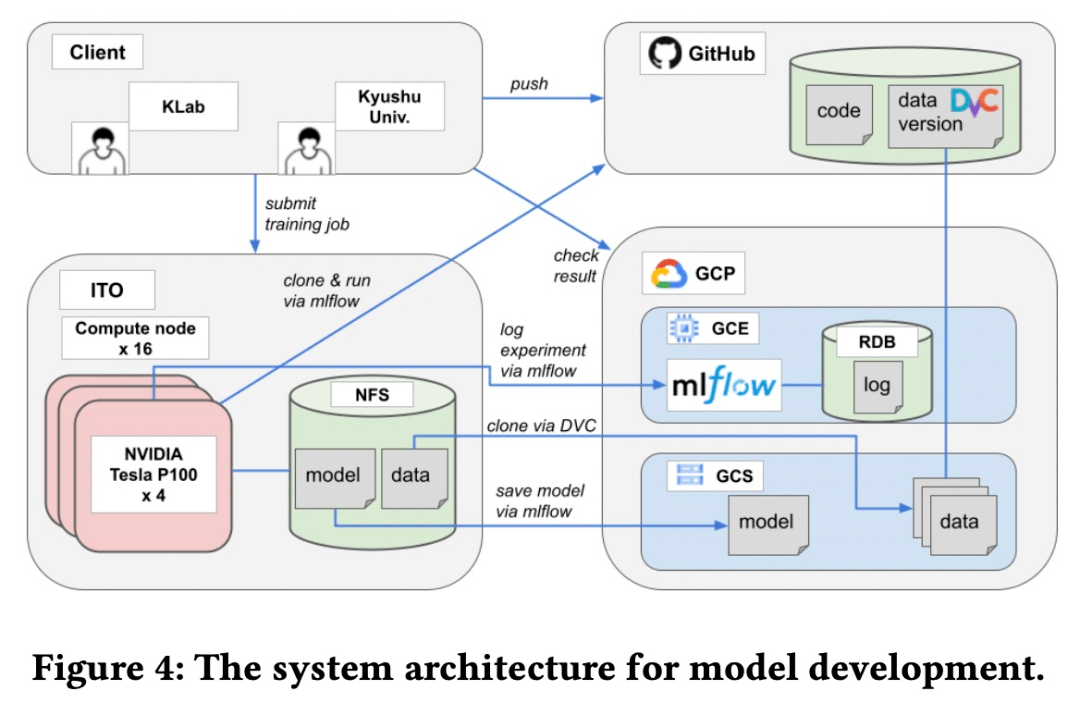

模型开发

该模型是由 KLab 和九州大学合作完成的 。 两个团队之间需要一个基于 Web 的协作平台来共享源代码、数据集、模型和实验等 。 具体来说 , 该研究用于模型开发的系统架构如下图所示 。

文章图片

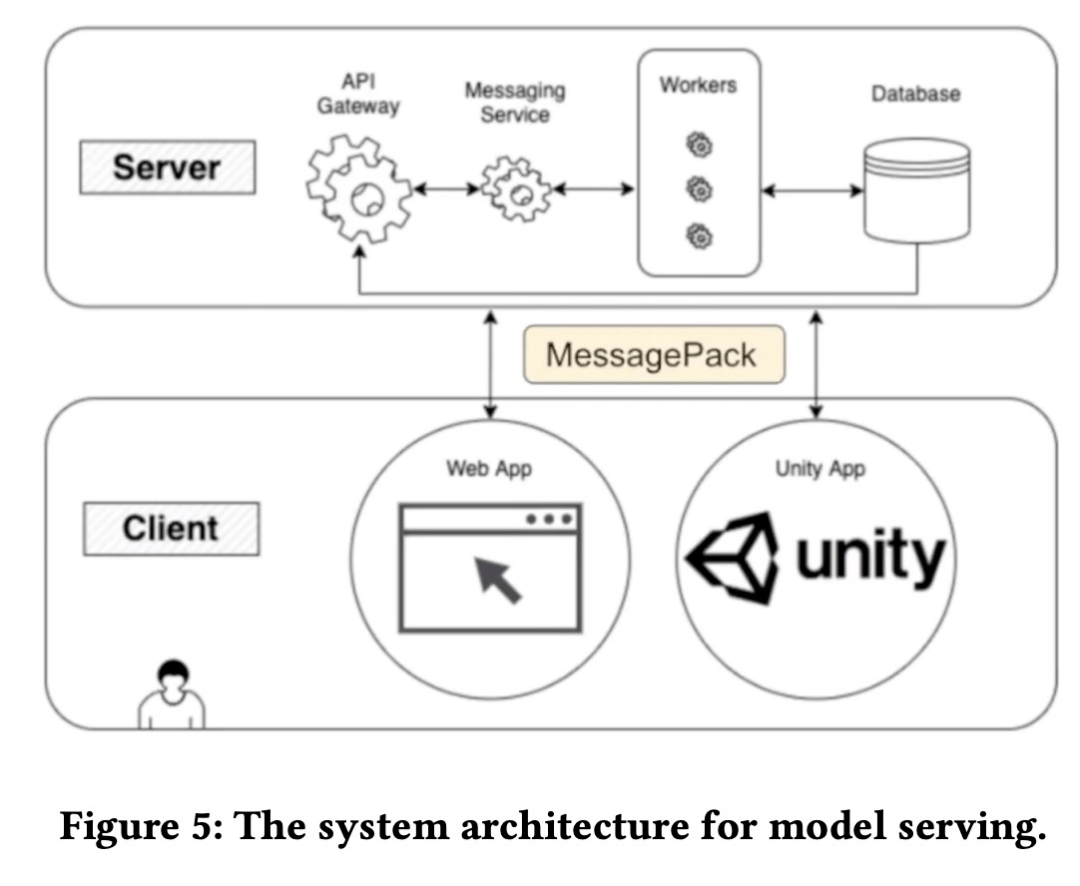

模型服务

为了使乐谱生成程序可供艺术家按需使用 , 它应该方便艺术家自行使用而无需 AI 工程师的帮助 。 并且由于该程序需要高端 GPU , 将其安装在艺术家的本地计算机上并不是一个合适的选择 。 该模型服务系统架构如下图所示 。

文章图片

实验结果

为了度量该方法中每个组件的性能 , 研究者在「Love Live! All Stars」数据集上进行了消融实验 。

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。