文章图片

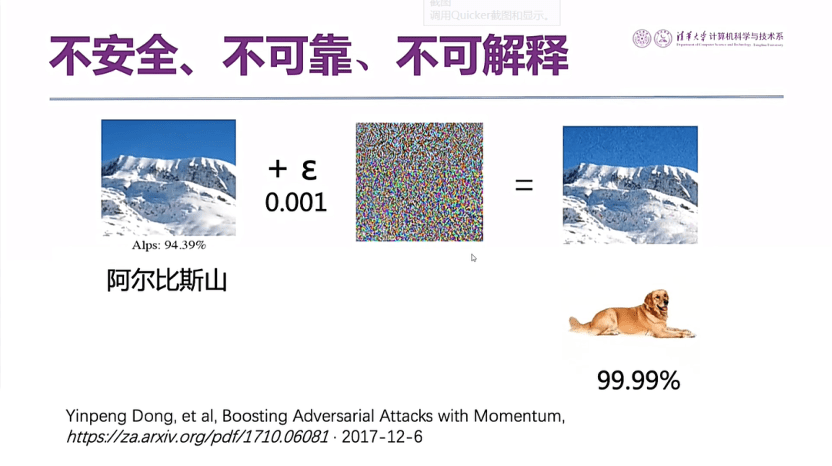

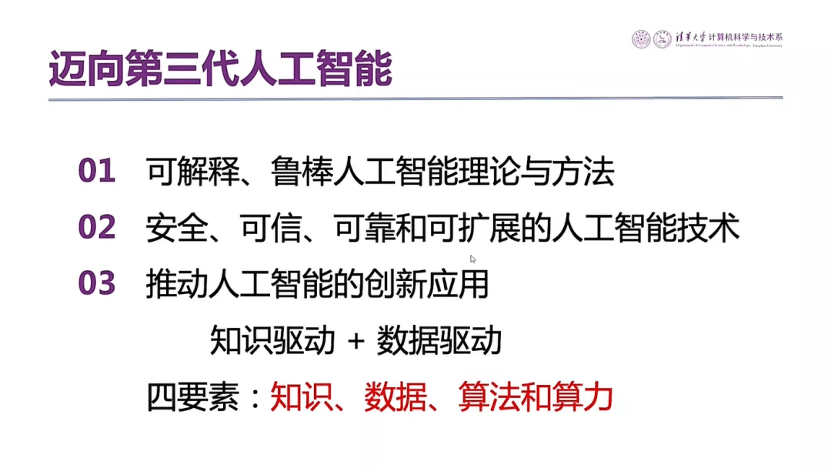

第三代人工智能需要克服第二代算法的不安全 , 不可解释 , 鲁棒性差等问题 。 张钹提出 , 发展第三代人工智能 , 最主要就是建立可解释的鲁棒人工智能理论 , 将知识驱动和数据驱动结合起来 , 充分发挥知识、数据、算法和算力四要素的作用 。

文章图片

第一代人工智能把语义处理(原来符号、知识的处理)放在离散的符号空间内完成 , 第二代人工智能我们把数据放在连续向量空间里来处理 , 这两个空间相互隔离 。 张钹在现场介绍了三空间的混合模型 , 通过这个模型 , 把这两个离散空间的模型跟连续空间的模型打通 , 在原来数据驱动基础上把相关的知识放到向量空间来处理 。

在这个思路下有两种方法 。 范式一是把所有处理都放在一个连续空间里作为向量进行处理 。 原来的深度学习方法 , 即使用非常局部的特征来区分鸟与其他动物 , 是很容易受到攻击的 。 当下的解决方式是尽可能通过各种各样的途径加上用概率或向量的方法表达的知识 。 常用的一种方式是在训练时使用对抗样本 , 即告知机器 , 该样本尽管在某些局部特征上与鸟相同 , 但不是鸟 。 但这种办法只是治标 , 即只对这种对抗样本有识别能力 , 对抗样本换成另外一种形式失去效用 。

范式二是无监督学习的方法 。 无监督学习的内容是建立周围常见物体的模型 , 比如人类的学习方式 , 其在生命早期就建立了狗和猫的模型 , 而且很容易通过举一反三建立起马的模型 。

在计算机中就是通过无监督学习或预训练产生很多马的模型 。 但问题在于建立一个物体的模型 , 特别是像马这样的非刚体模型 , 会有很多种的变形 , 这不仅仅是视觉的不同 , 而是比如像躺下的马与跑起来的马就是完全不同的模型 , 于是建立什么样的模型是需要探讨的问题 。

这两条路都非常艰巨 , 张钹认为 , 发展第三代人工智能是一项非常长期的任务 , 人工智能的安全和治理也是长期任务 , 这个安全问题是算法本身的不安全性引起的 , 要彻底解决还有很长的路要走 。

【向量|张钹院士:解决AI安全问题,把知识驱动和数据驱动结合起来】张钹最后总结道 , 解决人工智能安全性问题必须两手抓 。 一手抓治理 , 第二手抓创新发展 , 要克服人工智能算法本身的不安全性 , 这两者都是长期的任务 。

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。