文章图片

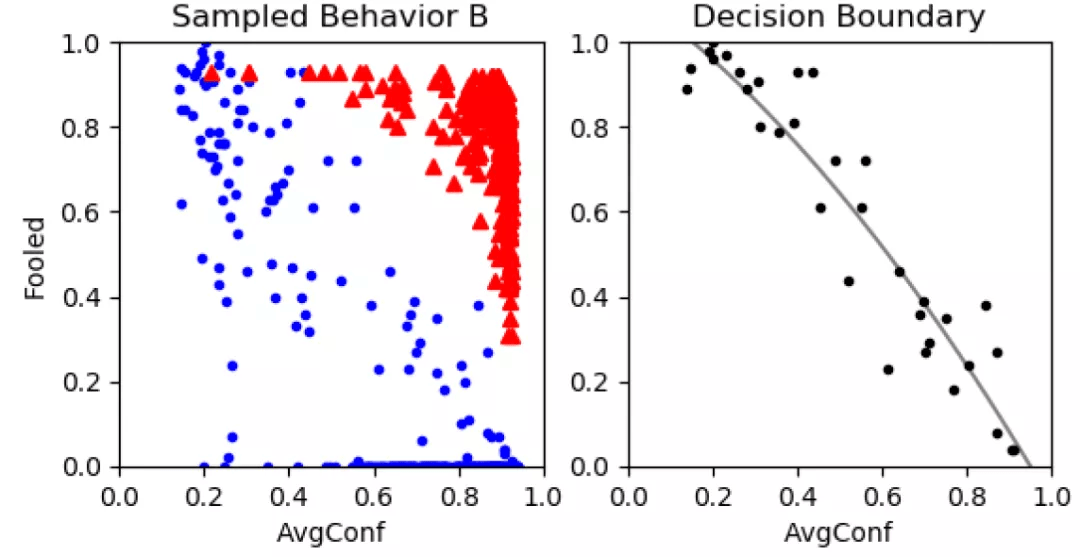

图 12. 边界检测示例 , 左侧 , 对抗性和良性指标分别被绘制成红色三角形和蓝色圆圈;右侧 , 来自采样点的曲线建议

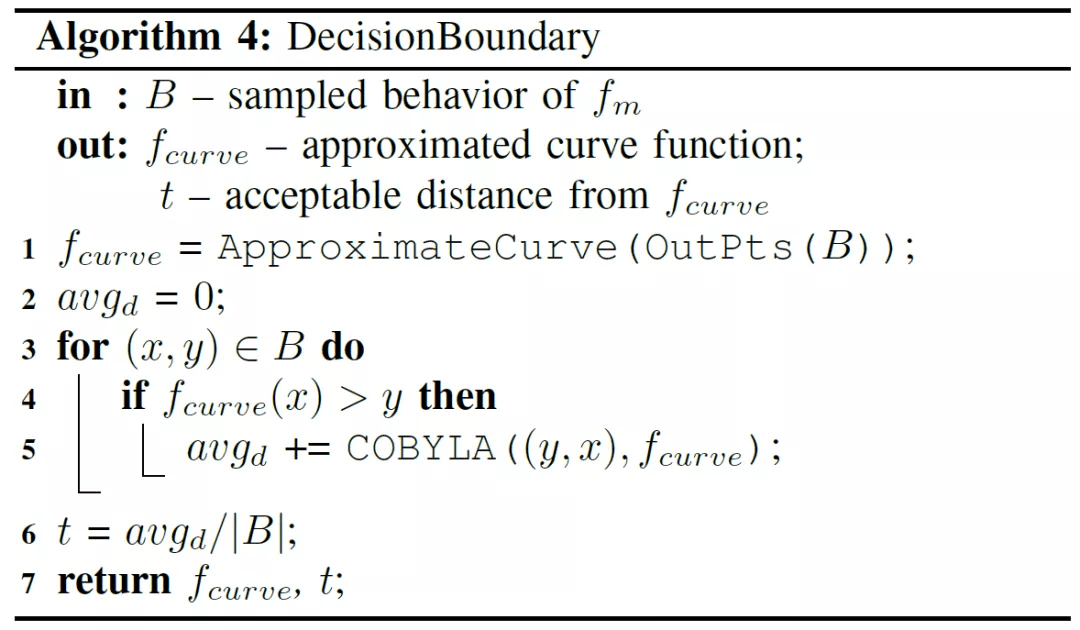

作者提出 , 可以使用在清洁样本上收集到的度量来近似一个曲线 , 其中位于曲线函数之外的点可以被归类为对抗性攻击 。 具体的 , 通过提取 x 间隔的最高 y 值的点来收集目标点 , 然后使用非线性最小二乘法函数来拟合生成目标曲线 。 然后 , 使用近似曲线计算曲线和点之间的距离(使用线性近似的约束优化(the Constrained Optimization by Linear Approximation , COBYLA)方法)并确定该距离是否在由位于曲线之外的清洁样本的距离所估计的阈值之内 , 来实现对攻击的分类 。 具体的边界决策过程如 Algorithm 4 所示 。

文章图片

3.2 实验分析

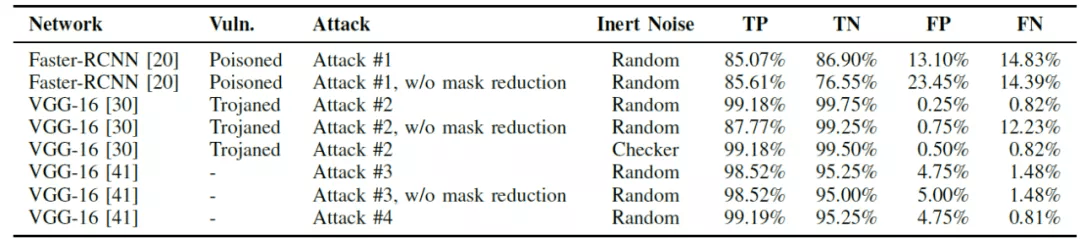

作者利用三个公共可用网络评估 SentiNet , 其中包括两个受损网络和一个未受损网络 。 受损网络包括一个用于阅读标志检测的后门 Faster-RCNN 网络 [11] 以及一个用于人脸识别的 VGG-16 trojaned 网络[12] 。 未受损网络是在 Imagenet 数据集上训练的 VGG-16 网络[13] 。 此外 , SentiNet 还需要一个良性测试图像集 X 和一个惰性模式 s 来生成决策边界 。 作者利用实验中所选网络的每个测试集 X 生成良性测试图像集 , 以及使用随机噪声作为惰性模式 。 SentiNet 利用 Tensorflow 1.5 为未受损网络、利用 BLVC Caffe 为 trojaned 网络以及利用 Faster-RCNN Caffe 为污染网络生成对抗补丁 。 为了能够并行生成类别建议 , SentiNet 利用了由 Fast RCNN Caffe 版本实现的 ROI 池化层 。 最后 , 作者通过收集每次攻击的 TP/TN 和 FP/FN 比率从准确性和性能两个方面衡量 SentiNet 的有效性和鲁棒性 。

首先 , 作者评估了 SentiNet 在保护选定的网络免受三种攻击的有效性 , 即后门、特洛伊木马触发器和对手补丁 。 在实验中 , 分别考虑了引入和未引入掩模改进的效果 。 对于对抗性补丁攻击 , 作者考虑了另一种变体 , 即攻击者同时使用多个补丁 。 实验整体评估结果见表 9 所示 。

文章图片

表 9. SentiNet 对已知攻击的有效性

接下来 , 作者考虑攻击者已知 SentiNet 的存在及其工作机制情况下 , 可能避免 SentiNet 检测的情况 。 作者具体考虑了 SentiNet 的三个组件的情况:热图建议、类别建议和攻击分类 。

1)攻击区域建议(热图建议)

本文方法的关键是能够使用 Grad-CAM 算法成功定位图像中的对抗性区域 。 Grad-CAM 算法生成 salient 区域的热图进而生成分类结果 。 一旦攻击破坏了 Grad-CAM 并影响区域的检测和定位 , 那么框架的后续组件将会失效 。 Grad-CAM 使用网络反向传播来衡量区域的重要性 。 因此 , 理论上我们可以使用有针对性的梯度扰动来修改热图输出 。 作者通过实验表明 , 在作者给出的防御背景下 , Grad-CAM 对对抗性攻击是稳健的 , Grad-CAM 对区域的捕捉能力并不会轻易被操纵 。

图 13 左上为一张狗的图像 , 上面覆盖着一个对抗性补丁 。 右侧为对目标类别 "toast" 的 Grad-CAM 热图 。 我们从随机噪声开始 , 其中没有任何 "toast" 类别的突出区域 , 对损失函数进行优化输入 。 图 13 证明了在收敛时生成的噪声的热图输出与原始热图在视觉上是一致的 。 这表明 , Grad-CAM 的输出是可以通过梯度优化来精确操纵的 。 然而 , 为了发动这样的有效攻击 , 攻击者需要在整个图像上添加噪声 , 这在实际上是不可行的 。

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。