机器之心报道

编辑:陈萍

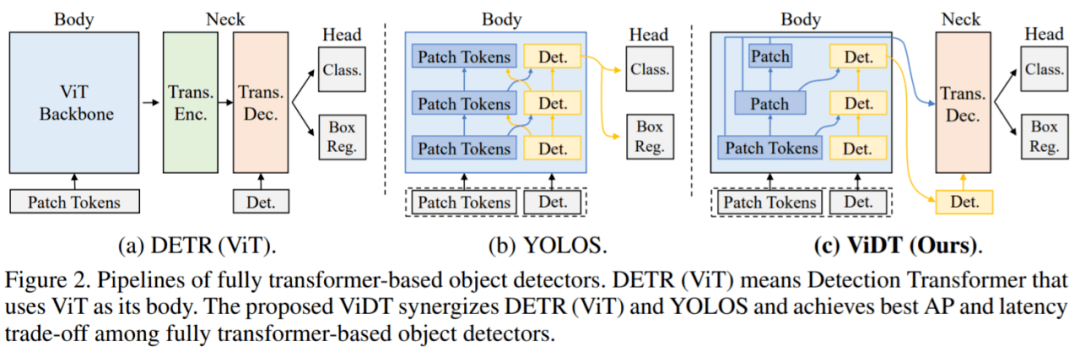

一种新的集成视觉和检测 Transformer 的目标检测器 ViDT 。Transformer 在 NLP 任务中取得不错的发展 , 许多研究将其引入到计算机视觉任务中 。 毫不夸张的说 , Transformer 正在改变计算机视觉的格局 , 尤其是在识别任务方面 。 例如 Detection transformer 是第一个用于目标检测的、端到端的学习系统 , 而 vision transformer 是第一个完全基于 transformer 的图像分类架构 。 在本文中 , 一篇被 ICLR 2022 接收的匿名论文集成了视觉和检测 Transformer (Vision and Detection Transformer , ViDT) 来构建有效且高效的目标检测器 。

ViDT 引入了一个重新配置的注意力模块(reconfigured attention module) , 将 Swin Transformer 扩展为一个独立的目标检测器 , 之后是一个计算高效的 Transformer 解码器 , 该解码器利用多尺度特征和辅助(auxiliary)技术 , 在不增加计算负载的情况下提高检测性能 。

在 Microsoft COCO 基准数据集上的评估表明 , ViDT 在现有的完全基于 transformer 的目标检测器中获得了最佳的 AP 和延迟权衡 , 其对大型模型的高可扩展性 , 可达 49.2AP 。

文章图片

论文地址:https://openreview.net/pdf?id=w4cXZDDib1H

ViDT:视觉与检测 Transformer

【完全基于Transformer的目标检测器,ICLR匿名论文视觉、检测统一】ViDT 架构如下图 2 (c) 所示:

- 首先 , ViDT 引入了一种改进的注意力机制 , 名为 Reconfigured Attention Module (RAM) , 该模块有助于 ViT 变体处理附加的 [DET(detection tokens)] 和 [PATCH(patch tokens)] token 以进行目标检测 。 因此 , ViDT 可以将最新的带有 RAM 的 Swin Transformer 主干修改为目标检测器 , 并利用其具有线性复杂度的局部注意力机制获得高可扩展性;

- 其次 , ViDT 采用轻量级的无编码器 neck 架构来减少计算开销 , 同时仍然在 neck 模块上启用额外的优化技术 。 请注意 , neck 编码器是不必要的 , 因为 RAM 直接提取用于目标检测的细粒度表示 , 即 [DET ] token 。 结果 , ViDT 获得了比 neck-free 对应物更好的性能;

- 最后 , 该研究引入了用于知识蒸馏的 token 匹配新概念 , 它可以在不影响检测效率的情况下从大型模型到小型模型带来额外的性能提升 。

文章图片

RAM 模块

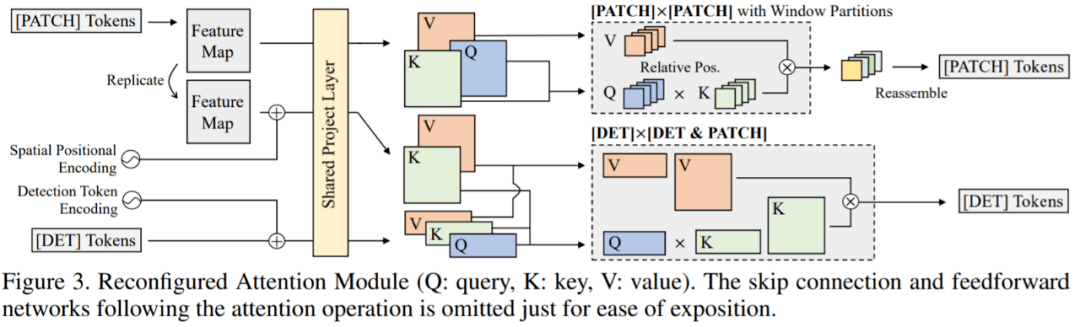

该研究引入了 RAM 模块 , 它将与 [PATCH] 和 [DET] token 相关的单个全局注意力分解为三个不同的注意力 , 即 [PATCH]×[PATCH]、[DET]× [DET] 和 [DET] × [PATCH] 注意力 。 如图 3 所示 , 通过共享 [DET] 和 [PATCH] token 的投影层 , 全部复用 Swin Transformer 的所有参数 , 并执行三种不同的注意力操作:

文章图片

ENCODER-FREE neck 结构

为了利用多尺度特征图 , ViDT 结合了多层可变形 transformer 解码器 。 在 DETR 家族中(图 2 (a)) , 其 neck 部分需要一个 transformer 编码器 , 用于将从骨干中提取的用于图像分类的特征转换为适合目标检测的特征;编码器通常在计算上很昂贵 , 因为它涉及 [PATCH] × [PATCH] 注意力 。 然而 , ViDT 只保留了一个 Transformer 解码器作为其 neck , 因为带有 RAM 的 Swin Transformer 直接提取适合目标检测的细粒度特征作为独立的目标检测器 。 因此 , ViDT 的 neck 结构在计算上是高效的 。

解码器从带有 RAM 的 Swin Transformer 接收两个输入:(1)从每个阶段生成的 [PATCH] token(2)从最后阶段生成的 [DET ] token , 如图 2 (c) 的 Neck 所示 。 在每个可变形的 transformer 层中 , 首先执行 [DET] × [DET] 注意力 。 对于每个 [DET] token , 应用多尺度可变形注意力以生成一个新的 [DET] token , 聚合从多尺度特征图

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。