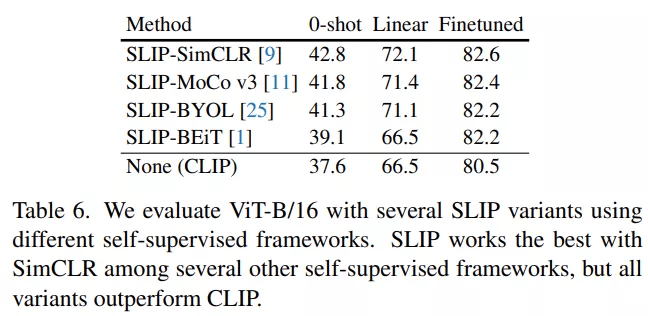

下表 6 显示 , 三种替代方法的表现都比不上 SLIP-SimCLR 。 最令人惊讶的结果是 , 尽管 BEiT 是这里测试的最强的自监督方法 , 但 SLIP-BEiT 的表现最差 。 这可能是由于预训练和部署阶段之间的输入差异较大 。 尽管如此 , 所有这些次优的 SLIP 变体仍然比 CLIP 性能要高 。

【当自监督遇上语言-图像预训练,UC伯克利提出多任务框架SLIP】

文章图片

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。